배경 및 개요

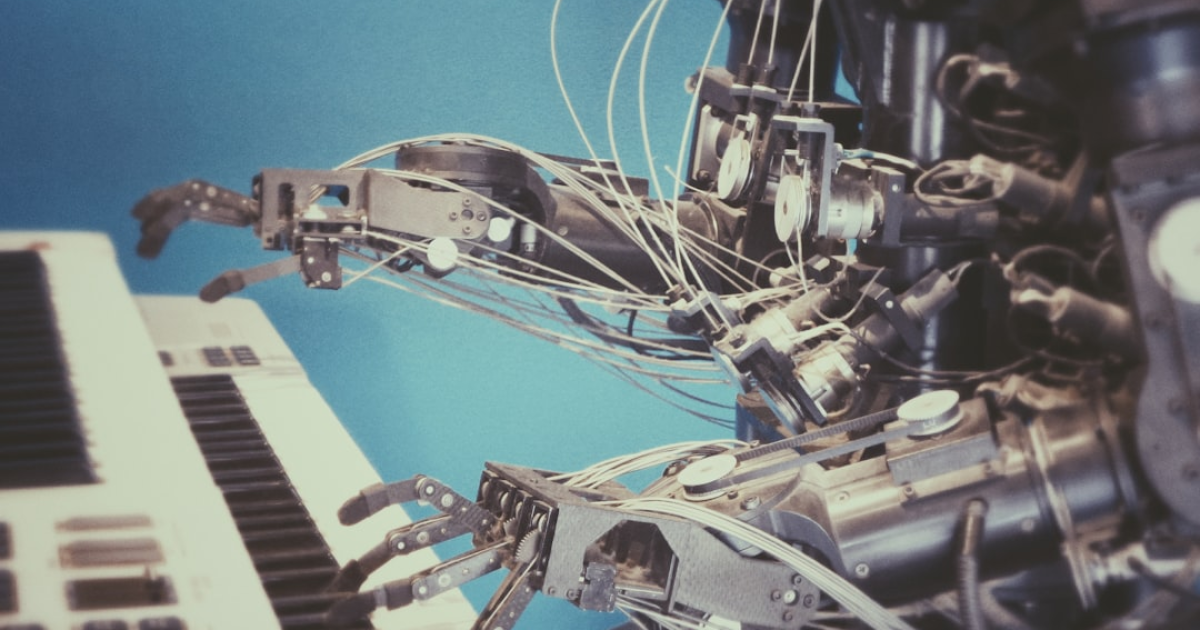

Anthropic는 미국 정부로부터 국방 분야 사용 허가를 받은 최초의 주요 AI 기업 중 하나였다. 하지만 Pentagon이 Anthropic와의 관계 재고를 시작했다. 이는 Anthropic이 특정 사건에 대한 참여를 거부했기 때문으로 알려졌다.

Anthropic은 군사작전을 목적으로 하는 AI 개발과 사용에 반대하는 입장이다. 반면 Pentagon은 "우리의 전투원들이 모든 전투에서 승리할 수 있도록 지원하는 동료가 필요하다"고 주장하며, Anthropic와의 불협화음을 드러내고 있다.

핵심 분석

Anthropic은 AI 모델 Claude를 군사적 목적으로 사용하지 않는다고 명시했다. 하지만 Pentagon은 국방 부문에 적용되는 AI 기술에 대한 제한적인 접근 방식을 받아들일 수 없다는 입장이다. Pentagon CTO Emil Michael은 AI의 군사적 활용을 막지 않고, 현실적으로 필요한 전투 대응 시스템 구축을 강조했다. 이는 Anthropic과 같은 안전주의적인 AI 개발 방식에 대한 큰 갈등을 야기하고 있다.

영향 및 파급효과

Anthropic와 Pentagon의 갈등은 군사용 AI 개발 방침에 대한 국제적 논쟁을 부추길 수 있다. AI 기술의 군사적 활용에 대해 더 많은 토론이 필요하며, 국제 사회는 안전하고 책임 있는 AI 개발에 적극적으로 참여해야 한다. 또한, 다른 AI 기업들이 Pentagon과의 협력 관계에서 어떤 선택을 할지 관찰해 볼 필요가 있다.

전망 및 시사점

AI 기술은 미래의 전쟁 방식을 형성하는 중요한 요소가 될 것이다. 따라서 AI 개발 과정에 윤리적 가치를 반영하고, 군사 사용에 대한 명확한 규범을 마련하는 것이 필수적이다. Anthropic와 Pentagon의 갈등은 AI 기술의 미래 방향에 대한 심각한 질문을 제기하며, 앞으로 국제 사회는 이러한 문제 해결에 적극적으로 나서야 한다.